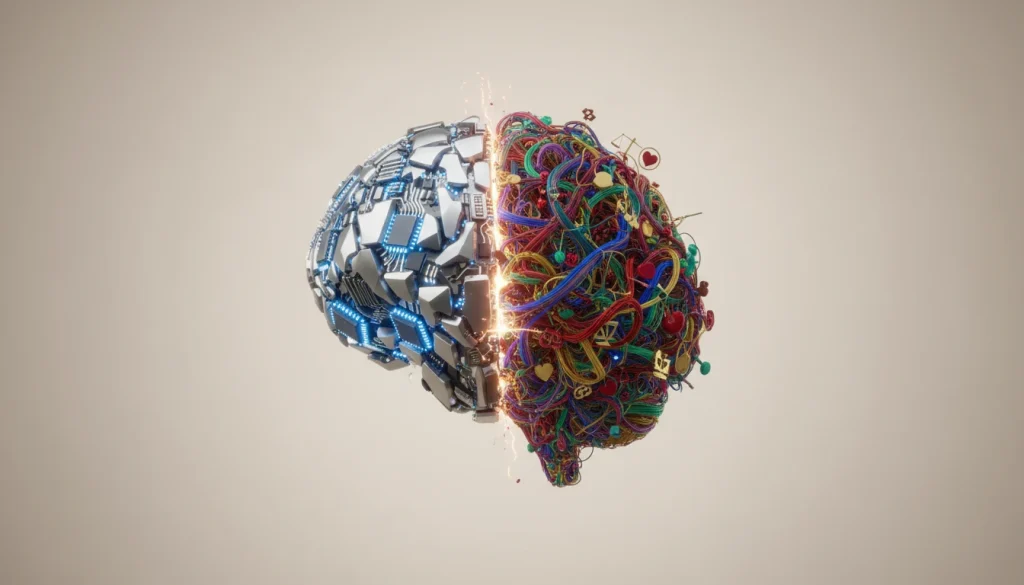

آیا تابهحال به این فکر کردهاید که وقتی با یک هوش مصنوعی صحبت میکنید، دقیقاً با «چه کسی» طرف هستید؟ شاید بگویید با مجموعهای از الگوریتمها و ریاضیات محض. اما بیایید صادق باشیم؛ ریاضیات وقتی وارد دنیای تصمیمگیریهای انسانی میشود، دیگر خنثی نیست. ما اغلب تصور میکنیم تکنولوژی یک ابزار بیطرف است، مثل یک چکش. اما هوش مصنوعی شبیه چکش نیست؛ شبیه معماری یک شهر است که تعیین میکند مردم چگونه زندگی کنند، چه کسی دیده شود و چه کسی در حاشیه بماند.

ماجرا از آنجا پیچیده میشود که بدانیم توسعهدهندگان این سیستمها، تنها مهندس نیستند؛ آنها حاملان ایدئولوژیهای خاصی هستند که خواسته یا ناخواسته در تار و پود کدهایشان تنیده میشود. در یک تحلیل عمیق و خواندنی که در وبسایت SSIR منتشر شده، نویسندگان پرده از این واقعیت برمیدارند که نبرد اصلی امروز، جنگ بر سر قدرت پردازش نیست، بلکه جنگ بر سر «ارزشها» است.

افسانه بیطرفی تکنولوژی

بزرگترین فریبی که شاید ناخودآگاه خوردهایم، باور به «عینی بودن» (Objectivity) دادههاست. مقاله اصلی به زیبایی تشریح میکند که چگونه هوش مصنوعی در خلأ شکل نمیگیرد. این سیستمها در اکوسیستمی متولد شدهاند که ارزشهای خاصی را ستایش میکند: کارایی، سرعت، و نوعی خاص از بهینهسازی که لزوماً با رفاه همگانی همراستا نیست. وقتی الگوریتمی برای «بهینهسازی سود» طراحی میشود، مفاهیمی مثل عدالت یا برابری میتوانند به عنوان «خطا» یا «نویز» در سیستم تلقی شوند.

اینجاست که نقش ما به عنوان ناظران هوشمند حیاتی میشود. نباید اجازه دهیم پیچیدگی فنی ماجرا، چشمانمان را بر واقعیتهای اجتماعی آن ببندد. سوال این نیست که «آیا این مدل کار میکند؟»؛ سوال این است که «این مدل برای چه کسی و با چه تعریفی از موفقیت کار میکند؟».

سه گانهی ایدئولوژیک: چه کسانی آینده را میسازند؟

اگر بخواهیم با استناد به تحلیلهای مطرح شده در این مقاله، نقشهی فکری پشت هوش مصنوعی را ترسیم کنیم، با چند جریان فکری اصلی روبرو میشویم که در حال شکلدهی به آینده ما هستند:

- تکنو-خوشبینها و شتابگرایان: گروهی که معتقدند تنها راه حل مشکلات بشر، پیشرفت هرچه سریعتر تکنولوژی است، حتی اگر در این مسیر چیزهایی شکسته شود. برای آنها، بازار آزاد و نوآوری بیقید و بند، مقدس است.

- بلندمدتگرایان (Longtermists): کسانی که نگران خطرات وجودی هوش مصنوعی در صد سال آینده هستند (مثل نابودی بشر توسط رباتها). این دیدگاه اگرچه جذاب است، اما گاهی باعث میشود رنجهای واقعی و تبعیضهای موجود در سیستمهای فعلی نادیده گرفته شود.

- منتقدان عدالتمحور: گروهی که فریاد میزنند هوش مصنوعی همین امروز در حال بازتولید نژادپرستی، تبعیض جنسیتی و نابرابری اقتصادی است.

تنش میان این دیدگاهها، همان چیزی است که شکل نهایی ابزارهایی مثل ChatGPT یا الگوریتمهای استخدام و وامدهی را تعیین میکند.

به سوی هوش مصنوعی در خدمت منافع عمومی

شاید ترسناکترین بخش ماجرا این باشد که این تصمیمات بزرگ، اغلب در اتاقهای دربسته و توسط گروهی کوچک و همگن (اغلب مردان سفیدپوست در سیلیکونولی) گرفته میشود. اما راه حل چیست؟ نویسندگان مقاله استدلال میکنند که ما نیاز به یک «هوش مصنوعی در خدمت منافع عمومی» داریم. چیزی شبیه به پارکهای عمومی یا کتابخانهها؛ فضایی که منطق سودآوری تنها حاکم آن نباشد.

این تغییر مسیر نیازمند دخالت جامعه مدنی، قانونگذاران و البته آگاهی من و شماست. ما باید از نقش «مصرفکننده منفعل» خارج شویم و بپرسیم: آیا این ابزار به دموکراسی کمک میکند یا آن را تضعیف میکند؟ آیا شکاف طبقاتی را کم میکند یا عمیقتر؟

در نهایت، هوش مصنوعی آینهای است در برابر بشریت. اگر تصویر کجی را نشان میدهد، شاید به این دلیل است که سازندگان آن آینه، تنها بخشی از واقعیت را میبینند. زمان آن رسیده که ما هم در صیقل دادن این آینه سهیم باشیم.